之前已經針對目前主流的立體顯示技術做了一個大概的介紹,而這一篇可以算是他的再延伸一點,來介紹一下從撥放端(撥放器或電腦)到顯示端(投影機或電視),一般是怎麼傳遞立體訊號的。

實際上,在去年 HDMI 1.4(HDMI 官方新功能列表)以及 DisplayPort 1.2(官方新聞稿)相繼推出之前,應該是沒有哪一種普遍在使用的訊號傳輸界面,是有特別去定義立體顯示訊號的;也因此,各家有投入立體顯示技術研發與製造的廠商,也製訂了許多不同的訊號傳輸的形式,用來作為立體視訊的傳輸方法。這也讓目前這方面的東西變得滿多、滿雜的,使用者買到的立體顯示設備,如果沒有搭配好對應的輸出設備(播放器),很有可能根本沒有辦法正常地看到正確的立體效果…

另外,在實務上根據立體顯示系統的原理與架構的不同,所需要的訊號形式可能也會有所出入,像是一般 2-View(雙視角、左右眼)的立體顯示設備就是需要能有左右眼兩個畫面,multi-view(多視角)的立體顯示系統則就必須要能提供更多個不同角度的畫面;而另外像是全像術等方法,所需要的資料也又是截然不同的形式。

而 Heresy 在這篇文章裡,會先以一般 2-view、也就是需要左右眼兩個立體畫面的系統為主,來做簡單地介紹。這類型的立體顯示系統實際上也是目前比較常見的,像是一般在電影院裡看的 3D 電影、或是 nVIDIA 3D Vision、iZ3D、DLP 3D 這些目前已經上市的立體顯示設備,大多都是屬於這一類。

由於 2-View 的系統最主要的需求,就是要能夠接收、並且用特殊的方法顯示左右眼不同的畫面,然後讓觀賞者的兩眼,能看到個別對應的畫面,以形成立體感。也因為這樣,這種系統要接收的立體視訊的訊號,主要就是兩個獨立、但是同步的畫面了∼

但是由於一般的視訊傳輸界面並沒有定義可以同時傳輸兩組視訊的方法,所以就出現了各種「繞路」的動作,想辦法透過現有的界面,來傳輸兩個畫面;而根據不同的方法,其實大多也都有適用於一些特別的立體顯示系統。這些方法主要大致可以分為下面幾種:

- 雙輸出。直接用兩條訊號線、一條一個畫面。

- 這種方法比較常見的稱呼方式有「Dual Screen Output 」或「Dual Output」。

- 基本上就是使用兩條訊號線(例如兩條 DVI 線)、一條傳送左眼的畫面、一條傳送右眼的畫面;而這樣的配置在單獨看其中一條線時,就和一般正常使用時是完全一樣的,所以對於現有的線材、設備來說,幾乎沒有差別。

- 因為這樣兩條線的訊號是完全獨立傳送的、頻寬也是獨立使用的,所以裡論上可以維持最好的解析度!但是相對的,在訊號來源的產生端,則必須要能確保兩條線的訊號是同步的,不然會產生兩眼畫面不一致的狀況。

- 而也由於這樣會有兩組訊號,所以大多會用在本來就需要兩台獨立顯示裝置的被動式立體顯示系統,尤其是使用兩台投影機的偏光立體系統與波長多路式立體系統。

- 以電腦系統來說,目前的顯示卡大多都有兩個以上的輸出接頭,所以可以簡單地做到這種輸出;而如果是 OpenGL 搭配 nVIDIA Quadro FX 這種專業的繪圖卡,就是使用 Quad Buffer Stereo 的「nView 仿製(nView Clone)」的設定。

- 切割時間,送出兩倍更新率的畫面。

- 這種方法比較常見的稱呼方式有「time sequential」、「page-flip」或「double framerate」等等。

- 基本上是透過加快畫面的更新率、交錯送出左右眼的畫面的方式,在一條訊號線裡,傳輸兩眼的訊號。不過一般都還必須要另外再送出同步訊號,來告訴顯示系統左右眼切換的確切時間點。

- 因為這種方法是把兩眼的影像在時間的層面上擠在一起,所以其實需要的資料量也是原來的兩倍;雖然基本上可以在不降低解析度的情況下傳輸兩眼的資料,但是如果所採用的傳輸界面頻寬不夠或品質不好的話,有可能會影響到畫質。而如果界面本身不能支援更高的更新率的話,也可能導至必須以降低更新率的方法來傳送訊號、造成視訊本身的動作連續性降低。

- 由於這種訊號的傳送方式和主動式立體的顯示方式大致上是相同的,所以這種訊號主要也多是給主動式立體的顯示系統使用;而同步訊號則會以各種不同的方式、傳送給快門眼鏡。

- 以專業電腦系統來說,這種立體同步訊號是經過 VESA 的 3-pin DIN 標準接頭來傳輸;但是這種接頭一般是做在專業級的繪圖卡上,對於一般玩家比較麻煩。

- 而像 nVIDIA 的 3D Vision 雖然也是採用這種架構,但是他的同步訊號是使用 USB 界面來和特殊的同步訊號發射器做傳輸。

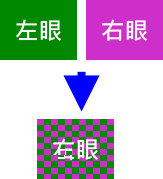

- 切割空間,把兩個畫面塞到一個畫面裡。

- 這類的方法主要概念就是把兩個畫面,用特別定義好的方法,塞成一個畫面;也因為這大致上是在一個畫面裡面硬塞兩個畫面,所以一般來說這種方法會讓畫面的解析度降低一半。

- 而在實作上根據不同的像素排列方法,有許多不同的方法,彼此之間也不相容。這些方法主要包括了下面五種:

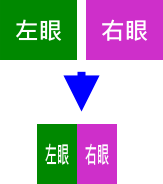

Left / Right

- 一般講的 Side By Side 就是這種。他的概念很簡單,就是把兩個畫面一左一右並排,當做一個畫面來傳送。

- 不過由於一般界面會有定義解析度的限制,所以大部分情況下,他會把左右兩眼的畫面的寬度都降低一半後,在做合併的動作,以符合解析度的限制,所以大致上會變得像右邊的示意圖一樣。

- 這樣的結果就是在立體播放時,實際上兩眼看到的解析度只有原來的一半。

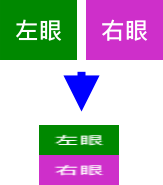

Up / Down

- 和 Left / Right 非常類似,只是兩個畫面合併方法不是左右,而是上下。

- 和 Left / Right 一樣可能會有解析度限制的問題,所以一般會是把兩個原始畫面的高度降低一半、減少一半的解析度後再合併(如右圖)。

- 另外也有將影像轉九十度後再合併的方法,這樣雖然解析度還是會少一半,但是由於一般的影像都是比較寬的,所以這樣可以避免只損失特訂軸向的解析度。(圖例)

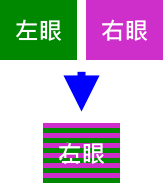

Row Interlaced

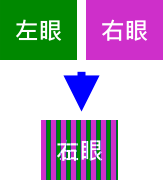

Column Interlaced

- 或稱 Vertical interlaced,基本上就是排列方法和 Row interlaced 轉 90 度。

- 主要應該也是用在一些採用偏光鏡被動式立體的平面顯示器上;不過使用 Column Interlaced 的顯示器前方的偏光膜排列方法和 Row Interlaced 的呈 90 度。

- 同樣的,在立體顯示時,實際的解析度只有原來的一半;不過解析度降低的是寬度。

Checkboard

- 是以類似西洋棋棋盤的方式,來做象素的排列。

- 這種方法的實際解析度也會降低一半,但是由於排列的方法較為特殊,所以比較不明顯。

- 這也是 DLP 3D 所使用的方法。

上面基本上就是一些可能比較常見的立體訊號了∼當然在實際上,還有許多沒有提到的東西,不過大致上都是類似的。而雖然各種訊號都有較適合的系統,但是在使用時,其實也可以透過額外的訊號轉換裝置,來對不同的訊號作轉換;像 RealD 就有一系列的「POD」,可以針對不同的訊號作轉換(例如:Page Flip POD)。

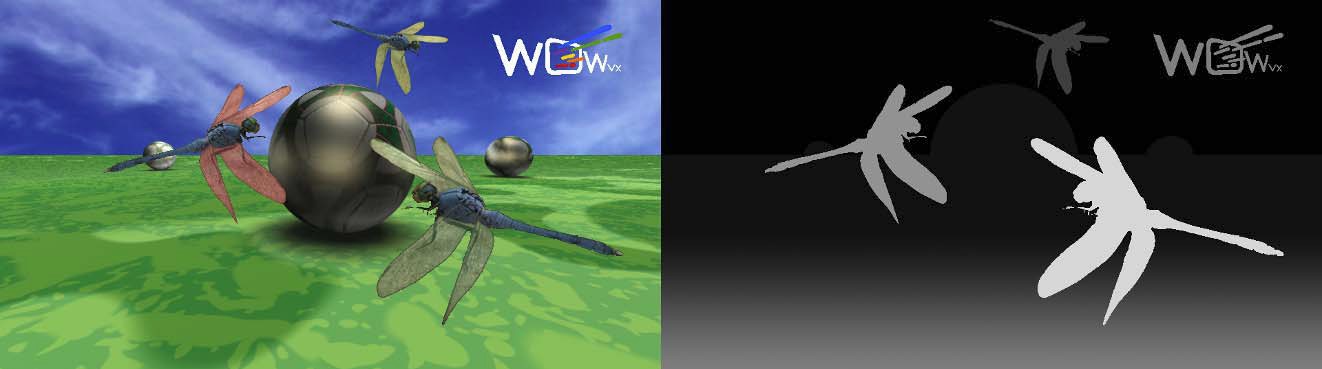

而上面講的,主要都是針對 2-View 的系統,所以也都只有提供左右兩眼的影像。不過像是 multi-view 的系統的話,由於需要多視角的資料,所以可能會採用其他類型的訊號;像是 Philips 的 WOWvx 裸眼立體顯示技術,就是使用所謂的「2D-plus-Depth」、也就是提供一張平面影像再加上深度資訊的方法。下圖就是取自飛利浦《3D Interface Specifications White Paper》的一張 2D plus Depth 的示意圖,左邊得就是一般看到的平面影像,右邊則是代表這張影像裡面,各位置的深度資訊(越接近白色代表越前面)。

顯示設備在得到這種訊號後,則會在用 computer vision 的演算法,利用深度資訊,產生出不同視角的影像,來做 multi-view 的立體顯示。

不過,這種各式各樣的立體訊號傳輸方法,在 HDMI 1.4 和 DisplayPort 1.2 這些新一代的標準出來後,在使用者的部分,應該就可以忽略掉了吧∼因為只要採用這種定義好的界面的話,設備就會自己處理好訊號的問題了;像是目前許多對應 Blu-ray 3D 、新上市的立體播放器、立體電視,主要都是支援 HDMI 1.4 的。

而以 HDMI 1.4 來說,他內部的立體訊號的實作,實際上是允許非常多種不同的形式;以規格書中附錄 H的「3D Structure」的資料來看,他支援的包括了:Frame packing、Field alternative、Line alternative、Side-by-Side (Full)、L depth、L depth graphics graphics-depth、Side-by-Side (Half)。這些多樣性的支援,在 Heresy 來看,主要應該也是為了能更方便地相容現有的訊號和設備了∼

如過是對於 HDMI 1.4 所支援的立體訊號格式有興趣的人,建議請直接參考 《High-Definition Multimedia Interface Specification Version 1.4 Extraction of 3D Signaling Portion》。

參考資料:

如何根据收到的信号判断该立体电视信号属于时间切割或者空间切割呢?谢谢~~

您好,這要看他的規格而論。如果他沒有送額外的判別訊號的話,單從收到的畫面很難自動去判斷。